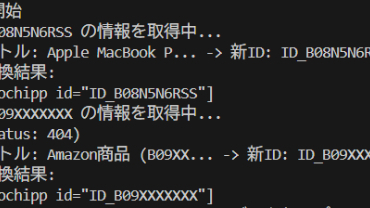

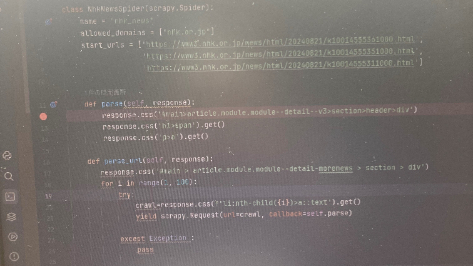

python初学者がスクレイピングでボートレースの結果1年分を取得してみた。

こんばんはブログって楽しいですね!中川です。帰って見てみると4つもいいねを頂いていたのでめちゃくちゃテンションあがっちゃいました。今日は昨日作ったボートレースの順位取得するアプリを強化し、自動的に多くの情報を取得できるようにしていきたいと思います。ちなみに前回完成したコードはこちらです。import numpy as np

import pandas as pd

import requests

import re

from bs4 import BeautifulSoupurl="ボートレースのサイト名/owpc/pc/race/resultlist?jcd=12&hd=20220417"res = requests.get(url)

soup = BeautifulSoup(res.text, "html.parser")

counter = 0

i=0

ranking_1 = []

ranking_2 = []

ranking_3 = []

for content in soup.find_all("span", class_='numberSet1_number'):

i+=1

if i%5==0 or i%5==4:

continue

number = re.sub(r"\D", "", content.text)

counter += 1

if counter%3 ==1:

ranking_1.append(int(number))

if counter%3 ==2:

0