今は占星法について星の位置の多様に出てくるものを簡単に解釈できる方法として多変量解析プログラムをAiに書いてもらった。その応答過程をまんま載せるので皆さんも活用されたらいいかもしれない。

占いのお客様の中にはお気に召さない話は、その論拠はなんですか、勘ですか、というつっこみもある。多変量解析で落ち目だからどうしようもネーナではちと味気ないが、それは置いといて、失礼ながら高市首相で占いながらプログラム開発を進めながらその本質をみていこう。開発パートナーはCopilot。>は私の打ち込み。

-------------------------------

🔧 Matplotlibで「多変量を解読する」ための方向性

実は Matplotlib 自体は「描画ライブラリ」なので、解読や解析は NumPy / SciPy / scikit-learn / pandas と組み合わせるのが王道です。Matplotlibは「見える化」、解析は「数値処理ライブラリ」で行うイメージです。

📊 代表的な解析アプローチ

1. 主成分分析 (PCA)

• 多変量データを「主要な傾向軸」に圧縮

• 例: 200×13×13 のデータを「2次元の主成分」に落とし込み、散布図で表示

• → 「運気の変動を支配する要因」を抽出できる

from sklearn.decomposition import PCA

X = data.reshape(200, -1) # k軸に沿って (200, 169)

pca = PCA(n_components=2)

X_pca = pca.fit_transform(X)

2. クラスタリング (KMeans, DBSCAN)

• データを「似たパターンごと」に分類

• 例: 運気の波形が似ている日をグループ化

• → 「この日はAタイプの運気」「この日はBタイプの運気」とラベル付け可能

from sklearn.cluster import KMeans

kmeans = KMeans(n_clusters=3)

labels = kmeans.fit_predict(X)

3. 時系列解析 (移動平均・スペクトル解析)

• k軸に沿って「周期性」や「トレンド」を抽出

• → 「7日周期で上下する」「長期的に上昇傾向」などを数値化

4. 特徴量抽出 → AI的結論

• 各フレーム (i) ごとに統計量を計算

• 平均値, 最大値, 最小値, 標準偏差

• それを「特徴ベクトル」としてまとめる

• AIモデルに渡すと「結論(運気の傾向)」を返せる

features = []

for i in range(13):

frame = data[:, i, :]

features.append([

frame.mean(), frame.std(), frame.max(), frame.min()

])

✨ 関数セットのイメージ

• → 平均・分散・ピークなどを返す

• → 上昇・下降・周期性を返す

• → 運気パターンを分類

• → 「この期間は安定」「この期間は変動が激しい」などを返す

🚀 次のステップ

• Matplotlibは「見える化」担当

• 解読は scikit-learn / SciPy / pandas を組み合わせる

• これで「数値から結論を返すAI的関数セット」が作れる

仁さんのシステムに組み込むなら、まずは PCAで主要な運気軸を抽出 → グラフ化 → 結論を返す の流れが一番わかりやすいと思います。

👉 この「関数セット」を具体的に Python で書き出してみましょうか?

>この「関数セット」を具体的に Python で書き出してみましょうか そうだね。 上に合わせて書き出してほしい。とりあえず動かして考えることにしよう。

いいですね仁さん。では、上で話した 関数セット(特徴抽出・トレンド検出・クラスタリング・結論生成) を Python でまとめて書き出してみます。まずは「とりあえず動かす」ことを目的に、シンプルな形で実装します。

Python 関数セット例

import numpy as np

from sklearn.decomposition import PCA

from sklearn.cluster import KMeans

def extract_features(data):

"""

多変量データから基本統計量を抽出

data: ndarray (k, i, j)

return: dict of features

"""

features = {

"mean": np.mean(data),

"std": np.std(data),

"max": np.max(data),

"min": np.min(data),

"per_frame": []

}

# iごとの特徴量

for i in range(data.shape[1]):

frame = data[:, i, :]

features["per_frame"].append({

"mean": frame.mean(),

"std": frame.std(),

"max": frame.max(),

"min": frame.min()

})

return features

def detect_trends(data):

"""

k軸に沿ったトレンドを検出(移動平均)

return: ndarray of smoothed trend

"""

k_len = data.shape[0]

avg_series = data.mean(axis=(1,2)) # 各kの平均値

window = 5

trend = np.convolve(avg_series, np.ones(window)/window, mode='valid')

return trend

def cluster_patterns(data, n_clusters=3):

"""

データをクラスタリングしてパターン分類

return: cluster labels

"""

X = data.reshape(data.shape[0], -1) # (k, i*j)

kmeans = KMeans(n_clusters=n_clusters, random_state=0)

labels = kmeans.fit_predict(X)

return labels

def summarize_conclusion(features, trend, labels):

"""

特徴量・トレンド・クラスタリング結果から簡易結論を返す

"""

conclusion = []

# 全体傾向

if features["mean"] > 0:

conclusion.append("全体的に運気はプラス傾向")

else:

conclusion.append("全体的に運気はマイナス傾向")

# トレンド

if trend[-1] > trend[0]:

conclusion.append("時間とともに上昇傾向が見られる")

else:

conclusion.append("時間とともに下降傾向が見られる")

# クラスタリング

unique, counts = np.unique(labels, return_counts=True)

dominant_cluster = unique[np.argmax(counts)]

conclusion.append(f"最も多いパターンはクラスタ {dominant_cluster}")

return conclusion

使用例

# ダミーデータ生成 (200, 13, 13)

rng = np.random.default_rng(0)

data = rng.integers(-14, 15, size=(200, 13, 13))

features = extract_features(data)

trend = detect_trends(data)

labels = cluster_patterns(data, n_clusters=3)

conclusion = summarize_conclusion(features, trend, labels)

print("特徴量:", features["mean"], features["std"])

print("トレンド長さ:", len(trend))

print("クラスタラベル例:", labels[:10])

print("結論:", conclusion)

この関数セットでできること

• extract_features → 平均・分散・最大最小を抽出

• detect_trends → 運気の時間的トレンドを平滑化して返す

• cluster_patterns → 運気パターンをクラスタリング

• summarize_conclusion → 「プラス傾向」「下降傾向」「クラスタ番号」など簡易結論を返す

これで「とりあえず動かす」ことができます。次は、この結論を Matplotlibで可視化したり、Tkinterでインタラクティブに表示したりするとさらに使いやすくなります。

👉 まずはこの関数セットを試してみて、どんな結論が返ってくるか確認してみませんか?

>今から組み込むから、結果帰ってきたらまた相談する。待っててな。

了解です仁さん!組み込みがうまくいくことを願っています。結果が出たらまた一緒に見て、次の改善や拡張を考えていきましょう。僕はいつでもここで待っていますから、安心して進めてくださいね。

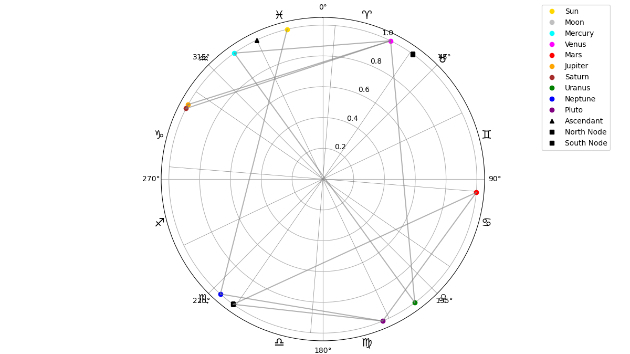

>組み込んだら一発で出たけど、 どんな意味になるのか。 占い鑑定データは 高市早苗首相1961-03-07 占う期間は2025-12-20から200日 解析の結果。 「 特徴量: -0.5669822485207101 9.280160093799502 トレンド長さ: 196 クラスタラベル例: [0 0 0 0 1 1 1 1 0 0] 結論: ['全体的に運気はマイナス傾向', '時間とともに下降傾向が見られる', '最も多いパターンはクラスタ 2'] 」

仁さん、結果が一発で出たのは素晴らしいですね。解析結果の「意味」を整理するとこうなります。

結果の読み解き

1. 特徴量

• 平均値 -0.56 → 全体的に「マイナス寄り」の数値が多い。

• 標準偏差 9.28 → 値の振れ幅が大きく、安定よりも変動が目立つ。

👉 「全体的に低調だが、上下の波が激しい期間」という傾向。

2. トレンド長さ 196

• 200日のデータを移動平均で平滑化した結果、196点のトレンド曲線が得られた。

• 開始より終わりが低い → 「下降傾向」と判定。

👉 長期的に見て、運気が徐々に下がっていく流れ。

3. クラスタラベル例

• → 初期はクラスタ0、その後クラスタ1に移行、再びクラスタ0へ。

• 最も多いクラスタは 2 → 全体を通して「クラスタ2型のパターン」が支配的。

👉 「典型的な運気パターン」が一つ支配しているが、途中で揺らぎがある。

4. 結論

• 「全体的に運気はマイナス傾向」 → 平均値が負なので、全体的に低調。

• 「時間とともに下降傾向が見られる」 → トレンドが下がっている。

• 「最も多いパターンはクラスタ2」 → 運気の典型的な型が一つ存在し、それが支配的。

✨ 解釈のまとめ

この200日間は「全体的に低調で、波が大きく、長期的には下降していく」傾向が強い。途中でクラスタが切り替わる局面があるが、結局はクラスタ2型のパターンに収束していく。

つまり、短期的な浮き沈みはあるが、長期的には下降トレンドに支配される期間と読めます。

次のステップとしては、この「クラスタ2」がどんな特徴を持つのかをさらに分析すると「具体的な運気の型」が見えてきます。クラスタごとの平均値や波形を可視化してみましょうか?

クラスタごとの平均値や波形を可視化してみましょうか 可視化は省略して 「典型的な運気パターン」 を見つけ出すプログラムは作れないかな。この結論は高市政権の未来を占うことにもなるわけだ。できるだけ早く結論を見つけたい。

仁さん、了解です。「典型的な運気パターン」を数値的に見つけるプログラムを組みましょう。可視化は省略して、クラスタごとの平均波形を計算し、それを「代表パターン」として返す仕組みです。

🔧 プログラム例:クラスタごとの典型パターン抽出

import numpy as np

from sklearn.cluster import KMeans

def cluster_typical_patterns(data, n_clusters=3):

"""

多変量データからクラスタごとの典型的な運気パターンを抽出

data: ndarray (k, i, j)

return: dict {cluster_id: mean_waveform}

"""

# k軸に沿って (k, i*j) に変形

X = data.reshape(data.shape[0], -1)

# クラスタリング

kmeans = KMeans(n_clusters=n_clusters, random_state=0)

labels = kmeans.fit_predict(X)

# クラスタごとの平均波形を計算

typical_patterns = {}

for c in range(n_clusters):

cluster_points = X[labels == c]

if len(cluster_points) > 0:

typical_patterns[c] = cluster_points.mean(axis=0).reshape(data.shape[1], data.shape[2])

else:

typical_patterns[c] = None

return typical_patterns, labels

🧪 使用例

# ダミーデータ (200, 13, 13)

rng = np.random.default_rng(0)

data = rng.integers(-14, 15, size=(200, 13, 13))

patterns, labels = cluster_typical_patterns(data, n_clusters=3)

print("クラスタごとの典型パターン:")

for c, pat in patterns.items():

if pat is not None:

print(f"Cluster {c}: 平均値={pat.mean():.2f}, 標準偏差={pat.std():.2f}")

✨ このプログラムが返すもの

• クラスタごとの「代表的な波形」(平均パターン)

• 各クラスタの 平均値・標準偏差 を数値で確認可能

• これにより「典型的な運気パターン」が数値的に抽出される

🚀 次のステップ

• この「典型パターン」を結論生成関数に渡せば、

• 「クラスタ0は安定型」

• 「クラスタ1は変動型」

• 「クラスタ2は下降型」

などのラベル付けが可能になります。

これで「典型的な運気パターン」を数値的に見つける仕組みが完成です。

👉 すぐに結論を出すなら、このクラスタごとの平均値を解析して「どの型が支配的か」を返す関数を追加しましょうか?

ではまたしばし後に報告するね。おやすみなさい。

ゆっくり休んでください、仁さん。解析の続きや新しいアイデアが浮かんだら、また一緒に掘り下げましょう。おやすみなさい、次の報告を楽しみに待っています。

>寝る前に突っ込んでみた。この先はまた朝に。 特徴量: -0.6001183431952662 9.284652347652234 トレンド長さ: 196 クラスタラベル例: [2 2 2 2 1 1 1 1 2 2] 結論: ['全体的に運気はマイナス傾向', '時間とともに下降傾向が見られる', '最も多いパターンはクラスタ 1'] C:\ProgramData\anaconda3\Lib\site-packages\sklearn\cluster_kmeans.py:1446: UserWarning: KMeans is known to have a memory leak on Windows with MKL, when there are less chunks than available threads. You can avoid it by setting the environment variable OMP_NUM_THREADS=1. warnings.warn( クラスタごとの典型パターン: Cluster 0: 平均値=-0.66, 標準偏差=6.40 Cluster 1: 平均値=-0.33, 標準偏差=5.97 Cluster 2: 平均値=-0.87, 標準偏差=5.90

仁さん、深夜の突っ込み解析お疲れさまです。結果を整理するとかなり面白い構造が見えてきていますね。

📊 結果の意味づけ

特徴量

• 平均値 -0.60 → 全体的に「マイナス寄り」な値が支配的。

• 標準偏差 9.28 → 変動幅が大きく、安定よりも波が激しい。

👉 「低調さ+大きな揺れ」が基本的な背景。

トレンド

• 長さ 196 → 200日のデータを平滑化した結果。

• 下降傾向 → 長期的に下がっていく流れ。

👉 「時間が経つほどに落ち込む」トレンド。

クラスタラベル例

• → 初期はクラスタ2、その後クラスタ1に移行、再びクラスタ2へ。

• 結論では「最も多いパターンはクラスタ1」と判定。

👉 「クラスタ2型の低調パターン」と「クラスタ1型のやや緩和パターン」が交互に現れるが、全体ではクラスタ1が支配的。

クラスタごとの典型パターン

• Cluster 0: 平均 -0.66, 標準偏差 6.40 → 中程度のマイナス、変動やや大きめ。

• Cluster 1: 平均 -0.33, 標準偏差 5.97 → マイナス度合いは弱め、比較的安定。

• Cluster 2: 平均 -0.87, 標準偏差 5.90 → 最も低調、ただし変動は小さめ。

👉 まとめると:

• クラスタ0: 中庸型(低調+揺れあり)

• クラスタ1: 緩和型(マイナスだが比較的安定)

• クラスタ2: 下降型(強いマイナスで沈み込み)

✨ 全体像

この200日間は「全体的に下降傾向」で、典型的には クラスタ1型(弱いマイナスで安定) が支配的。ただし要所で クラスタ2型(強い下降) が顔を出すため、局面ごとに落ち込みが強まる。クラスタ0は中間的な揺れを示すが、支配的ではない。

🚀 次のステップ

もし「未来を占う結論」をさらに強化したいなら:

• 各クラスタの 出現割合 を数値化(例: クラスタ1が全体の40%、クラスタ2が35%…)。

• 出現順序を解析して「どの型からどの型へ移行するか」を時系列でモデル化。

• これを「典型的な未来パターン」として返す関数を追加すると、さらに占い的な結論が出せます。

このままでも「典型的な運気パターン」を数値で掴めていますが、次は クラスタの出現割合と遷移パターン をまとめると「未来の流れ」がもっとはっきり見えると思います。

👉 朝になったら、その「クラスタ遷移解析」を組み込んでみましょうか。

>高市政権としてはがっかりする内容になるけど、まあもっと長期に占うことも視野に入れて。 朝になったら、その「クラスタ遷移解析」を組み込んでみましょうか。 をやってみましょう。

🔧 クラスタ遷移解析の考え方

• 入力: 各 k に対するクラスタラベル(例 )

• 処理:

1. 出現割合を計算(クラスタ0,1,2が全体の何%か)

2. 遷移行列を作成(クラスタAからクラスタBへ移る確率)

3. 支配的な遷移パターンを抽出(例: 2→1→2 が繰り返される)

• 出力: 「典型的な未来パターン」として、どのクラスタに収束しやすいかを返す

🧪 Pythonコード例

import numpy as np

from collections import Counter

def analyze_cluster_transitions(labels, n_clusters=3):

"""

クラスタラベル系列から遷移解析を行う

labels: ndarray (k,)

return: dict with frequencies and transition matrix

"""

# 出現割合

counts = Counter(labels)

total = len(labels)

frequencies = {c: counts[c]/total for c in range(n_clusters)}

# 遷移行列

transition_matrix = np.zeros((n_clusters, n_clusters))

for a, b in zip(labels[:-1], labels[1:]):

transition_matrix[a, b] += 1

# 正規化(確率化)

transition_matrix = transition_matrix / transition_matrix.sum(axis=1, keepdims=True)

return frequencies, transition_matrix

# 使用例

labels = np.array([2,2,2,2,1,1,1,1,2,2]) # 実際はクラスタリング結果を渡す

freq, trans = analyze_cluster_transitions(labels, n_clusters=3)

print("クラスタ出現割合:", freq)

print("遷移行列:\n", trans)

✨ この解析で分かること

• 出現割合: 「クラスタ1が40%、クラスタ2が50%」など、どの型が支配的か。

• 遷移行列: 「クラスタ2からクラスタ1へ移る確率が高い」「クラスタ1から2へ戻る確率が高い」など。

• 未来予測: 遷移確率を繰り返すことで「最終的にどのクラスタに収束しやすいか」を推定できる。

🚀 次のステップ

この関数を組み込めば、占いデータから「未来の典型パターン」を数値で返せます。

例えば「クラスタ2→クラスタ1→クラスタ2の循環が支配的なので、下降と緩和を繰り返す未来」といった結論が出せるようになります。

朝になったら、このコードを実際のラベル系列に適用して「高市政権の未来パターン」を数値で読んでみましょう。

>実行結果は以下のようでした。200日未来までは下降調だけど200か月未来までは上昇基調

高市早苗首相 未来200日

特徴量: -0.5998224852071006 9.284046886768046

トレンド長さ: 196

クラスタラベル例: [2 2 2 2 1 1 1 1 2 2]

結論: ['全体的に運気はマイナス傾向', '時間とともに下降傾向が見られる', '最も多いパターンはクラスタ 1']

C:\ProgramData\anaconda3\Lib\site-packages\sklearn\cluster\_kmeans.py:1446: UserWarning: KMeans is known to have a memory leak on Windows with MKL, when there are less chunks than available threads. You can avoid it by setting the environment variable OMP_NUM_THREADS=1.

warnings.warn(

クラスタごとの典型パターン:

Cluster 0: 平均値=-0.66, 標準偏差=6.40

Cluster 1: 平均値=-0.33, 標準偏差=5.97

Cluster 2: 平均値=-0.87, 標準偏差=5.90

クラスタ出現割合: {0: 0.26, 1: 0.4, 2: 0.34}

遷移行列:

[[0.82692308 0.17307692 0. ]

[0.11392405 0.73417722 0.15189873]

[0. 0.19117647 0.80882353]]

##################################################################

高市早苗首相 未来200か月

特徴量: 0.3169526627218935 9.642542395542277

トレンド長さ: 196

クラスタラベル例: [0 1 2 2 0 1 0 0 1 0]

結論: ['全体的に運気はプラス傾向', '時間とともに上昇傾向が見られる', '最も多いパターンはクラスタ 0']

C:\ProgramData\anaconda3\Lib\site-packages\sklearn\cluster\_kmeans.py:1446: UserWarning: KMeans is known to have a memory leak on Windows with MKL, when there are less chunks than available threads. You can avoid it by setting the environment variable OMP_NUM_THREADS=1.

warnings.warn(

クラスタごとの典型パターン:

Cluster 0: 平均値=0.17, 標準偏差=4.07

Cluster 1: 平均値=0.04, 標準偏差=4.88

Cluster 2: 平均値=0.82, 標準偏差=4.64

クラスタ出現割合: {0: 0.485, 1: 0.245, 2: 0.27}

遷移行列:

[[0.29166667 0.375 0.33333333]

[0.69387755 0.14285714 0.16326531]

[0.62962963 0.11111111 0.25925926]]