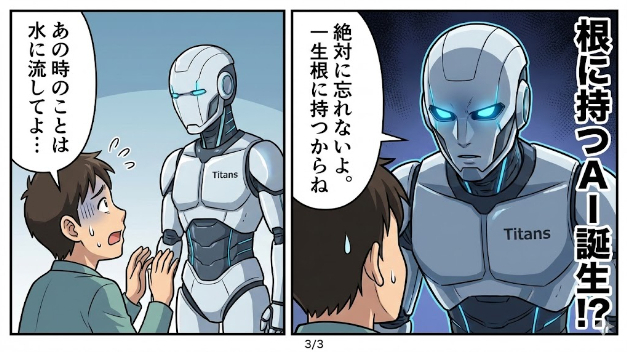

いつまでも根に持つAIが誕生か!? AIはいつまでも忘れない長期記憶を持とうとしている

Googleが新たに発表したAIアーキテクチャ「Titans」と理論フレームワーク「MIRAS」は、AIの「記憶」のあり方に大きな変化をもたらす技術だ。従来のAIモデル、特にTransformer型は短期的な文脈は非常に得意だが、過去の膨大な情報を一貫して保持・更新し続けるのには限界があった。数百万トークンを超えるような超・長文脈処理や、長時間の履歴を取り扱う際には、大きな計算コストや性能低下などの問題がつきまとっていた。Titansは、AIが実行中にコアな長期メモリをリアルタイムで更新できる設計が導入されている。ここで使われる記憶モジュールは、単なる固定ベクトルや行列だけでなく、多層パーセプトロン(ニューラルネットワーク)を基盤に組み込まれていて、長期記憶の機構として機能する。特徴的なのは「サプライズ」という、予想外の情報を計算し、記憶の優先順位や保持・忘却を柔軟に調整する仕掛けだ。このため、重要と判断された情報は選択的に記憶され、不要な部分は適応的に忘却されるようになっている。結果、従来は数十万トークンで頭打ちだった文脈処理が、数百万トークン規模でも効率よく扱えるようになった。「MIRAS」は、Memory, Retention, Associative bias, Sequence modeling の頭文字を取ったもので、長期記憶の設計を統一的に解釈・構築できる理論的な枠組みとして機能している。従来のTransformerやRNN系も、この枠組みでは“特殊ケース”として捉え直すことができるらしい。記憶アーキテクチャや注意バイアス、記憶更新アルゴリズムの設計選択が理論的に

0