Pythonを使用して、指定されたWebサイトからデータを自動収集(スクレイピング)し、

様々なファイル形式(Excel、csv、googleスプレッドシートなど)にまとめます。

手作業でのコピー&ペーストや集計に時間を取られている方におすすめです。

一度仕組みを作れば、定期的なデータ更新も自動化できます!

⚫︎できること

・Webサイトからのデータ自動収集(商品情報・口コミ・求人・ニュースなど)

・収集データをGoogleスプレッドシートに自動出力

・CSV・Excel形式での納品にも対応

・API連携(例:Google Drive、Google Maps など)も応相談

⚫︎こんな方におすすめ

・ECサイトの商品情報をまとめたい方

・競合サイトの価格や在庫をチェックしたい方

・求人情報やニュース記事を自動で集めたい方

・研究やレポートのためにデータを整理したい方

・チームで共有できるスプレッドシートに自動反映したい方

⚫︎納品物

・スプレッドシート上のデータ(またはCSV/Excelファイル)

⚫︎納期目安

2〜5日(サイト構造やデータ量によって変動します)

⚫︎料金料金について

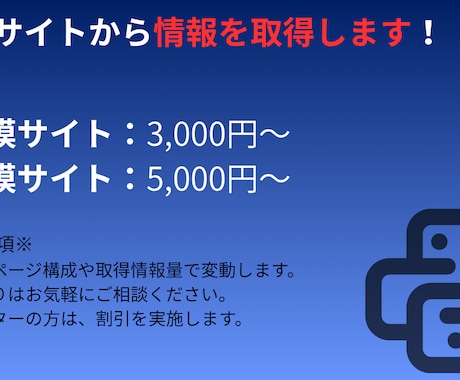

・小規模サイトータ収集(1サイト) ¥3,000〜

・複数サイト・大規模データ ¥5,000〜

└サイト構造理解のための時間が必要なため、別途料金をいただく場合があります。

サイトによりますが、1ページ10項目の場合、600ページ分

⚫︎ご依頼の流れ

①「どんなサイトから、どんな情報を取りたいか」をお知らせください

②サンプルデータを10件程度ご確認いただきます。

※この時点では料金は発生しません。

③問題なければ本番データを収集・スプレッドシートに反映します

④必要に応じてスクリプトや自動更新の設定も行います

⚫︎最後に

「このサイトはスクレイピングできる?」「こんなデータは取れる?」など、

事前にご相談いただければ、無料で可否を確認いたします。

お気軽にご相談ください。

最適な方法で、あなたの作業を自動化・効率化いたします!

⚫︎注意事項

・利用規約でスクレイピングが禁止されているサイトは対応できません

・公序良俗に反する内容のサイトはお受けできません

・データ量・サイト構造により追加費用が発生する場合があります(事前にご案内します)