Open WebUIは、LlamaなどのローカルLLMモデルを使用してChatGPTのような画面でチャットができるUIアプリです。

以下のような様々なユースケースに適しています。

• 機密情報を含んだメッセージをLLMに送信したい

• 完全に無料でツールの使用も含めたモデルの推論を実行したい

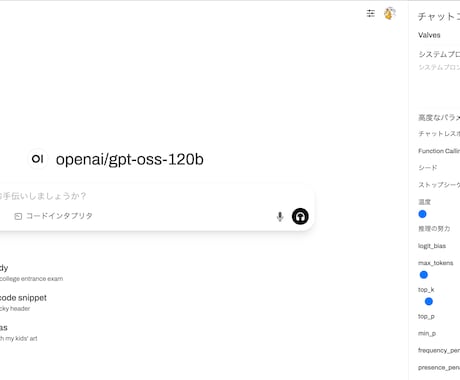

• OOpenAI(ChatGPT)やGemini, Anthropic(Claude)など複数の異なるプロバイダー間で同じUI画面を使ってやり取りしたい/同じプロンプトに対して同時に複数のモデルを使って出力を比較したい

• モデルのパラメータを細かく制御して出力を微調整したい

• カスタムツールを使用したい

ローカルモデルだけでなく、APIキーがあればOpenAIやGemini, Anthropicなどの最新モデルも使うことができますので、現在使っているお気に入りのモデルがある場合も継続して問題なくOpen WebUI上で使用することができます。

個人的にもかなりの頻度で使っているツールですので、AI初心者からITエンジニアまで幅広い層にとって導入するメリットが非常に大きいと考えています。

Python仮想環境のセットアップ、Ollamaのインストール、Dockerコマンドなど、導入に必要な手続きを徹底サポートするのはもちろん、OpenAI(ChatGPT)やGemini, AnthropicなどLLM APIの使用についてもサポートいたします。

付属の資料を提供した上で、環境構築時のエラー対応など個々の問題に対応いたします。

お使いのPCのOSやスペック等についてご記載いただけると導入がスムーズです。

わからない場合も適宜対応いたします。

例:

MacBook Pro(M1 Apple Silicon)

メモリ 32GB

ストレージ 245.72 GB利用可能 / 994.66 GB

OllamaによるローカルLLMモデルのインストールには、一般的に1モデルあたり3-15GBの空きストレージ容量が必要です。